17 febbraio 2024

Digital Services Act pienamente in vigore nell’Ue

e

Perché è un rischio per la libertà di parola su internet

Il Digital Services Act è entrato pienamente in vigore il 17 febbraio

La Commissione Ue ha presentato una proposta per un pacchetto digitale il 15 dicembre 2020, che comprende il Digital Services Act (la legge sui servizi digitali) e il Digital Markets Act (la legge sui mercati digitali).

Dopo poco più di un anno di negoziati all’interno del Parlamento e del Consiglio dell’Ue e tra co-legislatori, il 25 aprile 2022 è arrivata l’intesa definitiva, che ha sancito la pietra miliare del

“ciò che è illegale offline, è illegale online”.

Il 16 novembre 2022 il Digital Services Act è entrato parzialmente in vigore – applicandosi in primo luogo alle piattaforme di grandi dimensioni.

Queste sono state identificate in 19 fornitori di servizi digitali dalla Commissione Ue come dominanti dello spazio online e dovevano inviare all’esecutivo comunitario una valutazione dei rischi ciascuno sulla propria piattaforma, con scadenza 25 agosto 2023.

Ma la sua piena applicazione è in vigore a partire dal 17 febbraio 2024.

Digital service Act in vigore

Chi era coinvolto al 16 novembre 2022

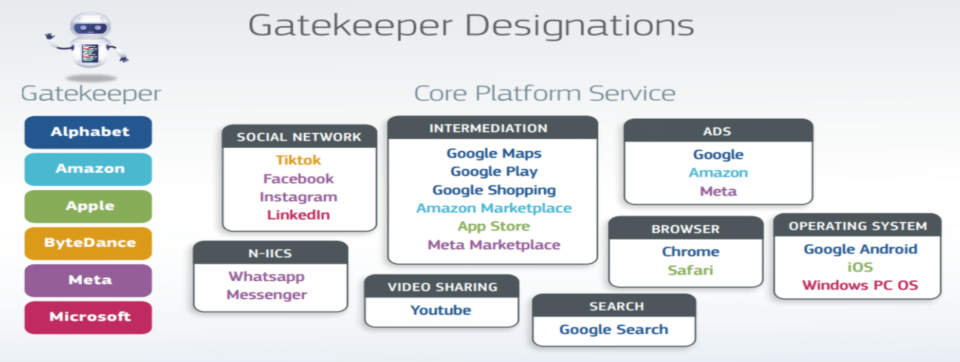

I 19 fornitori di servizi digitali, identificati come dominanti dello spazio online, sono:

– 2 grandi motori di ricerca (VLOSEs, in gergo):

Bing e Google Search

– 17 grandi piattaforme online (VLOPs):

social media (Facebook, Instagram, Twitter, TikTok, Snapchat, LinkedIn, Pinterest),

servizi di commercio elettronico (Alibaba AliExpress, Amazon Store, Apple AppStore, Zalando),

servizi Google (Google Play, Google Maps e Google Shopping),

e anche Booking.com, Wikipedia e YouTube.

Per questi attori dominanti, la responsabilità della vigilanza è della Commissione Europea.

Digital service Act in vigore

Cosa cambia al 17 febbraio 2024

Anche le piattaforme e motori di ricerca con meno di 45 milioni di utenti attivi mensili sono tenute a rispettare le indicazioni del nuovo Regolamento Ue sulla responsabilizzazione e protezione degli utenti online attraverso la mitigazione dei “rischi sistemici” e l’applicazione di “solidi strumenti di moderazione dei contenuti”.

Tra questi i sistemi di profilazione e raccomandazione di contenuti, privacy e sicurezza dei minori online, contenuti illegali ed effetti negativi sulla libertà di espressione e di informazione, accesso ai dati per i ricercatori attraverso un meccanismo speciale.

Sempre dal 17 febbraio sarà attiva la nuova architettura di vigilanza paneuropea, di cui la Commissione sarà l’autorità competente ma in stretta collaborazione con i coordinatori nazionali dei servizi digitali nel quadro del Digital Services Act (tra cui Agcom per l’Italia), responsabili per la vigilanza di piattaforme e motori di ricerca più piccoli.

Un Centro europeo per la trasparenza algoritmica (Ecat) fornirà assistenza a tutti gli attori di vigilanza per valutare se il funzionamento degli algoritmi è adeguato con le linee rosse della legislazione comunitaria.

Quali sono gli obblighi secondo il Digital Services Act

Gli obblighi previsti dal Digital Services Act stimolano a responsabilizzare e proteggere gli utenti online attraverso la mitigazione dei “rischi sistemici” e l’applicazione di “solidi strumenti di moderazione dei contenuti”.

Gli utenti dovranno ricevere informazioni “chiare” sul motivo per cui vengono raccomandate loro determinate informazioni e avranno il diritto di rinunciare ai sistemi di raccomandazione basati sulla profilazione (sempre vietata invece per i minori), mentre gli annunci pubblicitari non potranno essere basati sui dati sensibili dell’utente (origine etnica, opinioni politiche, orientamento sessuale).

Per quanto riguarda la protezione dei minori, le piattaforme dovranno riprogettare i loro sistemi per garantire un “elevato livello” di privacy e sicurezza.

Tratto da: EuNews

Piccole-medie imprese

Secondo un report della Commissione europea, sono più di 10.000 le piattaforme che devono sottostare alle condizioni del Dsa: di queste, oltre il 90% è rappresentato dalle piccole-medie imprese.

La Commissione si è posta come obiettivo quello di

«garantire che le piccole piattaforme online non siano colpite in modo sproporzionato, pur rimanendo responsabili»

aggiungendo che

«le piccole imprese e le microimprese sono esentate dagli obblighi più costosi, ma sono libere di applicare le migliori pratiche, per il loro vantaggio competitivo».

non sono mancate, in sede di dibattito, le polemiche da parte delle aziende tecnologiche per gli ingenti costi di adeguamento previsti, soprattutto in termini di trasparenza. È stato tuttavia chiarito che le micro e le piccole-medie imprese (con un fatturato annuo inferiore a 50 milioni di euro e meno di 250 dipendenti) sono escluse dagli obblighi di trasparenza aggiunti da questa normativa.

Tratto da Avvenire.it

Perché il Digital Service Act è un rischio per la libertà di parola su internet

Il regolamento pone particolare attenzione al fenomeno della “disinformazione” restando però sul vago, non definendo nel dettaglio ciò che può essere considerato come tale.

Di conseguenza, anche eventuali opinioni o studi difformi dalla linea “istituzionale” potrebbero venire etichettati come disinformazione.

Al punto 84 del DSA si legge:

«Nel valutare i rischi sistemici individuati nel presente regolamento, tali fornitori dovrebbero concentrarsi anche sulle informazioni che non sono illegali ma contribuiscono ai rischi sistemici individuati nel presente regolamento. Tali fornitori dovrebbero pertanto prestare particolare attenzione al modo in cui i loro servizi sono utilizzati per diffondere o amplificare contenuti fuorvianti o ingannevoli, compresa la disinformazione. Qualora l’amplificazione algoritmica delle informazioni contribuisca ai rischi sistemici, tali fornitori dovrebbero tenerne debitamente conto nelle loro valutazioni del rischio».

Il testo risulta ancora più esplicito per quanto riguarda eventuali situazioni di crisi, quali una minaccia per la sicurezza o la salute pubblica, calamità naturali o atti di terrorismo.

In questi casi, al punto 91 si legge:

«La Commissione dovrebbe poter chiedere ai prestatori di piattaforme online di dimensioni molto grandi e ai prestatori di motori di ricerca online di dimensioni molto grandi, su raccomandazione del comitato europeo per i servizi digitali («comitato»), di avviare con urgenza una risposta alle crisi. Le misure che tali prestatori possono individuare e considerare di applicare possono includere, ad esempio, l’adeguamento dei processi di moderazione dei contenuti e l’aumento delle risorse destinate alla moderazione dei contenuti […]»

Tutte le eventuali future emergenze potrebbero, dunque, fornire il pretesto per limitare la libertà d’informazione censurando opinioni, dati e studi non allineati.

La reale portata della legge sulla libertà d’informazione

Per questi motivi, una parte dell’opinione pubblica identifica la legge come un modo per imporre una sorta di censura mascherata finalizzata ad evitare che si possano esprimere tesi e opinioni divergenti da quelle “dominanti”.

La facoltà di vigilare sulla correttezza delle informazioni e dei contenuti, stabilendo, dunque, ciò che è vero e ciò che è falso è stata attribuita in primo luogo ad un organo politico: la Commissione Europea e, nello specifico, al Comitato europeo per i servizi digitali che vigilerà strettamente sulle società e sui contenuti.

Un’architettura di controllo che ha portato diversi rappresentanti politici e dell’informazione a parlare di una minaccia per la democrazia.

Non si tratta di perplessità e critiche che giungono solo dal mondo dell’attivismo o della contro-informazione.

Alcune preoccupazioni sono state espresse anche dal Garante per la privacy italiano che ha spiegato:

«il Regolamento sembrerebbe intenzionato a riconoscere – come, peraltro, ormai avviene diffusamente – ai gestori delle piattaforme il diritto-dovere di decidere in autonomia e sulla base semplicemente delle proprie condizioni generali quale contenuto lasciare online e quale rimuovere e quale utente lasciar libero di pubblicare e quale condannare all’ostracismo digitale»

concludendo senza giri di parole che

«il rischio è che anziché ridimensionare le big tech, si accresca il loro impatto sulle nostre società e democrazie».

Il tutto senza tralasciare che, grazie ai cosiddetti Twitter Files, è emerso che dietro alle grandi piattaforme vi sia la pressione dei governi che dettano ai colossi del digitale la linea politica e ideologica da seguire.

Infine, si sottolinea come il potere di decidere sulla correttezza e sulla legittimità dei contenuti sia eccessivamente sbilanciato verso la Commissione europea che avrà anche accesso agli algoritmi, assumendo così un ruolo “plenipotenziario”.

Secondo il Garante, infatti, sia che si tratti della questione della pubblicità targettizzata, sia che si tratti della moderazione dei contenuti pubblicati dagli utenti,

«è indispensabile che ogni competenza faccia capo o a un Giudice o a un’Autorità indipendente mentre potrebbe essere un grave errore attribuirla a un soggetto politico come la Commissione».

In altre parole, vi è il rischio concreto che le opinioni, gli studi scientifici, le analisi politiche e sociali dei cittadini europei siano sottoposte al controllo stringente di un organo politico, con il rischio non trascurabile della messa al bando dal discorso pubblico di ogni opinione classificata come “disinformazione” con criteri oscuri e potenzialmente restrittivi.

Una mossa che dietro una presunta tutela degli interessi degli utenti nasconde un rischio democratico evidente.

FONTE: L’Indipendente

Inter

Intervista al dr Barrie Trower, celebre fisico inglese, esperto in armi a microonde. Ha lavorato per la Marina Reale ed i servizi segreti. È uno dei massimi espert mondiali di microonde, campi elettromagnetici e 5G Intervista del 2018, ma sempre attuale per una migliore comprensione.

“Il grilletto è già stato premuto con il wi-fi, il 5G è sol il passo successivo”

1.18 spiegazione frequenze 5G 2.30 Armi a microonde

4.15 Effetti sulla natura

5.28 Importanza vitale degli alberi

13.22 Effetti sulla popolazione di insetti, in particolare sulle api

15.51 Effetti biologici sulla salute umana

26.59 Sarebbe possibile generare una falsa epidemia con il 5G?

33.46 Conferenza internazionale top secret a Varsavia nel 1973. 300 pagine di documenti tuttora secretati.

44.37 Fibra ottica

47.18 Le persone usano la tecnologia in modo nevrotico. Siamo di fronte ad una sorta di pandemia?

49.00 Già dl 64 a.C. si sapeva che le radiazioni fotoniche che colpiscono gli occhi, procuravano diversi effetti sull’uomo

55.08 5G è la stessa tecnologia che utilizza il governo americano per controllare le folle?

56.57 Elon Musk ed i satelliti Starlink, perchè sono così importanti per il 5G?

01.01.20 Spiare attraverso il cellulare

01.06.18 Quali paesi non consentono il 5G?

01.14.08 Testimonianza del dr. Trower rilasciata in Oregon, sugli effetti delle microonde

01.20.40 Danno “termico” e “danno sotto-termico”

01.24.40 Cosa possiamo fare?