Le truffe con i deepfake sono aumentate del 3000% nel 2023

Onfido, una startup londinese che si dedica alla creazione di metodi di autenticazione sicuri, ha pubblicato un report da cui emerge che i tentativi di truffa basati su deepfake sono aumentati del 3000% nel 2023.

Secondo i dati di Onfido, la causa è l’accesso a tantissime applicazioni di IA generativa online a prezzi molto bassi o gratuite.

Il problema, infatti, sarebbe che i cybercriminali puntano sulla quantità e non sulla qualità: non pochi attacchi sofisticati, ma tantissimi attacchi di livello medio basso.

Cosa sono i deepfake

Un deepfake è un contenuto audio o video che simula la voce o l’aspetto di una persona o addirittura un evento e che viene realizzato tramite tecnologie di deep learning, ovvero quel tipo di intelligenza artificiale in grado di analizzare grandi volumi di dati e utilizzarli per crearne di nuovi, come modelli di linguaggio o previsioni.

I deepfake sono nati pochi anni fa e sono diventati tristemente famosi grazie a video falsi su personaggi famosi o app che consentivano di “spogliare” una donna a partire da una sua fotografia.

Il passo dalla cyberviolenza al cybercrimine è stato corto, e oggi gli hacker li utilizzano per lanciare attacchi contro sistemi di riconoscimento biometrico o nelle campagne di disinformazione, come vedremo più avanti.

Aumento truffe del 3000%

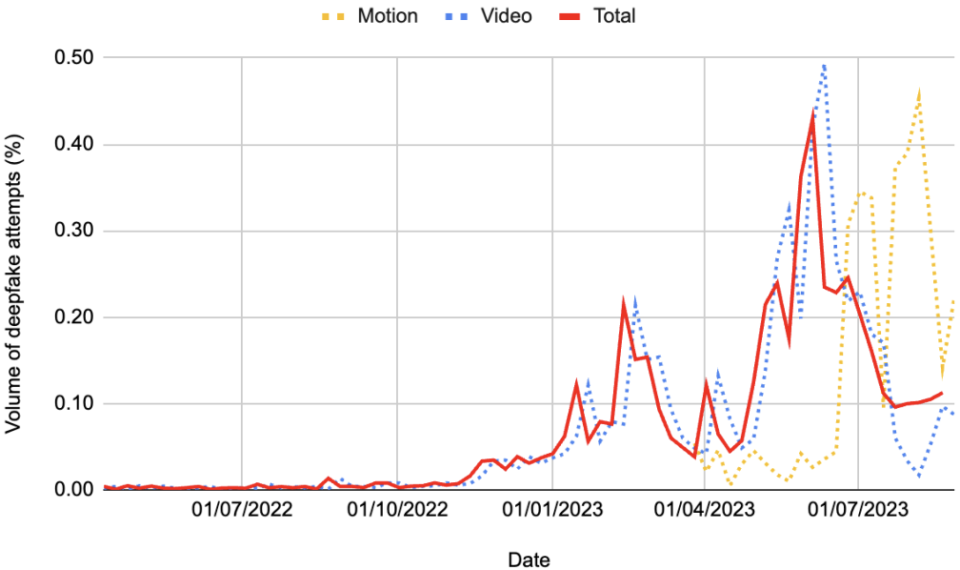

Il report di Onfido si è concentrato sulla diffusione dei deepfake.

I risultati sono molto chiari: durante l’ultimo anno sono stati rilevati più del 3000% di deepfake rispetto al 2022.

Un aumento che, secondo Onfido, è legato strettamente all’IA generativa.

Queste sono le cause di questa impennata delle frodi basate sui deepfake:

- Perfezionamento dei deepfake grazie all’IA generativa, come DALL-E.

- Accesso ad applicazioni di IA per la creazione di deepfake direttamente online, a cambio di poco denaro o senza costi.

- Facilità di esecuzione della creazione dei deepfake.

- Attacchi di media complessità in grandissime quantità, con guadagni unitari bassi, ma molto alti nel complesso.

Insomma, il panorama dei deepfake e delle truffe che li utilizzano è cambiato rapidamente.

Grazie alle nuove app di intelligenza artificiale generativa e alla facilità con cui anche un cybercriminale alle prime armi e senza grandi competenze può utilizzarle per preparare attacchi informatici.

Obiettivi di queste truffe

Per capire meglio questo fenomeno, è interessante vedere quali sono gli scopi per cui vengono utilizzati i deepfake:

- Falsificazione di identità. I deepfake vengono utilizzati per rubare l’identità di una persona e utilizzarla, ad esempio, per bypassare sistemi di autenticazione visiva.

- Manipolazione di contenuti video. I deepfake sono la base, insieme alle fake news, delle campagne di disinformazione utilizzate da media e partiti politici disonesti. I deepfake, inoltre, vengono utilizzati per rovinare la reputazione di persone famose.

- Simulazione di fatti non accaduti.

Per lo stesso motivo di cui sopra, i deepfake possono essere usati per simulare eventi e diffondere notizie false.

Molte ricerche in questo ambito hanno dimostrato che le campagne di disinformazione hanno come primo obiettivo quello di instillare il dubbio nelle persone e creare diffidenza verso le autorità, prima ancora di rovinare la reputazione di un partito o di una persona. - Truffe nelle videochiamate.

Con un deepfake è possibile realizzare truffe ed estorsioni simulando la presenza di una persona,

ad esempio per ottenere informazioni confidenziali durante una call di lavoro oppure per confermare un’operazione finanziaria che fa parte di una truffa più ampia. - Manipolazione audio.

La stessa cosa può essere fatta tramite la simulazione della voce di una persona, ad esempio per autenticarsi tramite comandi vocali.

Questi sono i principali scopi criminali dei deepfake.

Ricordiamo che la strategia di base dei nuovi cybercriminali, nella maggioranza dei casi, non è colpire una vittima determinata con un attacco complesso, ma lanciare un attacco a tappeto, sfruttando strumenti semplici e gratuiti.

Come proteggersi dai deepfake

Ogni giorno siamo esposti a messaggi fraudolenti, che simulano o dissimulano eventi per convincerci a fare clic su un link, rivelare un dato personale o scaricare un virus.

Il phishing e le truffe online si sono moltiplicate da quando esiste l’intelligenza artificiale generativa, che consente agli hacker di confezionare messaggi, video deepfake e attacchi di buona qualità, in poco tempo e senza avere grandi competenze tecniche.

Ecco cosa possiamo fare, come utenti finali, per proteggerci dai deepfake:

- Mantenere sempre un pizzico di diffidenza nei confronti di messaggi e video sospetti.

- Imparare ad analizzare con calma i messaggi che riguardano persone famose, partiti politici o eventi importanti a livello globale.

- Utilizzare siti di fact-checking e cercare informazioni online per vedere se qualcuno ha già scoperto che il video che stiamo guardando è un deepfake.

Esistono, inoltre, metodi di ricerca inversa, soprattutto a partire da immagini, che consentono di fare ricerche esaustive e analizzare anche il contesto per capire se un contenuto è stato inventato o raffigura qualcosa che esiste davvero. - Osservare con attenzione i video: anche se l’IA generativa è molto più accurata dei sistemi di deep learning di un anno fa, ci sono spesso piccoli dettagli che tradiscono la natura fasulla del video.

Questi comprendono: sfarfallii, espressioni fisse o poco naturali, movimenti poco naturali della bocca rispetto al resto del viso, forme e posizioni strane di mani e braccia, piccoli ritardi o pause nella pronuncia delle parole. - Utilizzare le tecnologie anti-deepfake: la stessa IA che viene usata per generare i deepfake può essere impiegata per riconoscerli. Online troverai molti di questi strumenti.

- Attenzione alle filigrane: molti creator aggiungono una filigrana digitale o in sovraimpressione per contrassegnare i propri video.

- Utilizzare sistemi di autenticazione biometrica di qualità: se decidi di proteggere casa tua o un server con il riconoscimento facciale o della voce (ottima idea, tra l’altro), scegli sistemi e dispositivi sicuri, che rispettino gli standard del settore, che abbiano un firmware recente e che includano una tecnologia antifrode.

Questi sono i nostri consigli per difenderti dai deepfake, sia come potenziali destinatari sia come potenziali vittime a cui potrebbero rubare l’identità.

Come abbiamo visto, la diffusione dell’IA generativa ha dato un nuovo slancio alle truffe online basate sui deepfake,

ma a medio e lungo termine ci aiuterà a riconoscerle e immunizzarci contro questo tipo di attacchi informatici.

FONTE: PandaSecurity

Inter

Intervista al dr Barrie Trower, celebre fisico inglese, esperto in armi a microonde. Ha lavorato per la Marina Reale ed i servizi segreti. È uno dei massimi espert mondiali di microonde, campi elettromagnetici e 5G Intervista del 2018, ma sempre attuale per una migliore comprensione.

“Il grilletto è già stato premuto con il wi-fi, il 5G è sol il passo successivo”

1.18 spiegazione frequenze 5G 2.30 Armi a microonde

4.15 Effetti sulla natura

5.28 Importanza vitale degli alberi

13.22 Effetti sulla popolazione di insetti, in particolare sulle api

15.51 Effetti biologici sulla salute umana

26.59 Sarebbe possibile generare una falsa epidemia con il 5G?

33.46 Conferenza internazionale top secret a Varsavia nel 1973. 300 pagine di documenti tuttora secretati.

44.37 Fibra ottica

47.18 Le persone usano la tecnologia in modo nevrotico. Siamo di fronte ad una sorta di pandemia?

49.00 Già dl 64 a.C. si sapeva che le radiazioni fotoniche che colpiscono gli occhi, procuravano diversi effetti sull’uomo

55.08 5G è la stessa tecnologia che utilizza il governo americano per controllare le folle?

56.57 Elon Musk ed i satelliti Starlink, perchè sono così importanti per il 5G?

01.01.20 Spiare attraverso il cellulare

01.06.18 Quali paesi non consentono il 5G?

01.14.08 Testimonianza del dr. Trower rilasciata in Oregon, sugli effetti delle microonde

01.20.40 Danno “termico” e “danno sotto-termico”

01.24.40 Cosa possiamo fare?